英语原文共 13 页,剩余内容已隐藏,支付完成后下载完整资料

SuperPoint:自监督地检测特征点并生成描述子

摘要

本文提出了一种自监督的框架,用于训练兴趣点检测器和描述符,这些兴趣点检测器和描述符适用于计算机视觉中的大量多视图几何问题。 与基于补丁的神经网络相反,我们的全卷积模型在全尺寸图像上运行,并在一次前向传递中共同计算像素级兴趣点位置和相关描述符。 我们介绍了同形匹配技术(Homographic Adaptation),这是一种多尺度,多应同性方法,可提高兴趣点检测的可重复性并执行跨域自适应(例如,合成图像到真实图像)。 我们的模型在使用Homographic Adaptation在MS-COCO通用图像数据集上进行训练后,能够反复检测到比初始预先适应的深度模型和任何其他传统角检测器更丰富的兴趣点集。 与LIFT,SIFT和ORB相比,最终的系统在HPatches上具有最新的单应性估计结果。

1.介绍

几何计算机视觉任务(例如同时定位和映射(SLAM),运动结构(SfM),相机校准和图像匹配)的第一步是从图像中提取兴趣点(特征点)。兴趣点(特征点)是图像中的2D位置,从不同的光照条件和视点来看,这些位置稳定且可被重复观测到。数学和计算机视觉的子领域(称为多视图几何[9])由定理和算法组成,这些定理和算法的前提是可以可靠地提取兴趣点并在图像之间进行匹配。但是,大多数实际计算机视觉系统的输入都是原始图像,而不是理想的点位置。在几乎所有需要图像作为输入的任务上,卷积神经网络已被证明优于手工设计的表示。特别是,预测2D“关键点”或“地标”的全卷积神经网络已针对各种任务进行了深入研究,例如人体姿态估计[31],物体检测[14]和房间布局估计[12]。这些技术的核心是由人工标记的2D ground truth locations的大型数据集。

类似地将兴趣点检测公式化为大规模的有监督的机器学习问题,并训练最新的卷积神经网络体系结构来检测它们似乎是很自然的。 不幸的是,当与诸如人体关键点估计之类的语义任务进行比较时(其中训练了网络来检测诸如嘴角或左脚踝之类的身体部位),兴趣点检测的概念在语义上是不明确的。 因此,在兴趣点的强监督下训练卷积神经网络并非易事。

我们没有使用人工监督来定义真实图像中的兴趣点,而是提出了一种使用自我训练的自我监督解决方案。 在我们的方法中,我们在真实图像中创建了一个大型的具有伪真值兴趣点位置数据集,该数据集由兴趣点检测器本身进行监控,而不是大规模的人工注释工作。

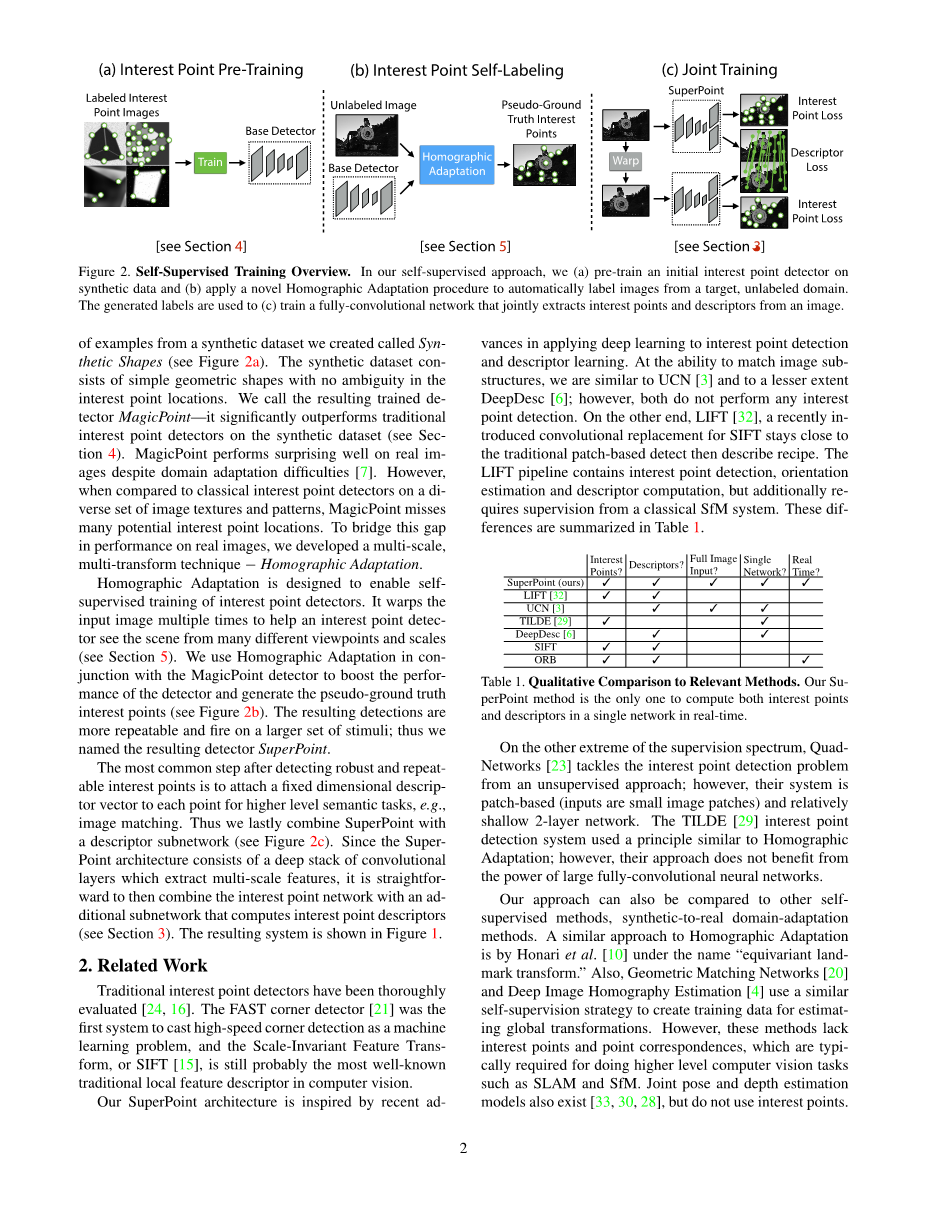

为了生成伪真值兴趣点,我们首先在我们创建的名为“合成形状”的合成数据集中,对数百万个示例进行了全卷积神经网络训练(见图2a)。 合成数据集由简单的几何形状组成,兴趣点位置没有歧义。 我们称这种检测器的训练结果为MagicPoint,它大大优于综合数据集上的传统兴趣点检测器(请参见第4节)。 尽管存在域自适应困难,但MagicPoint在真实图像上的表现还是出乎意料的[7]。 但是,与各种图像纹理和图案上的经典兴趣点检测器相比,MagicPoint错过了许多潜在的兴趣点位置。 为了弥合实际图像上的性能差距,我们开发了一种多尺度,多变换技术——Homographic Adaptation(单应性适应)。

图2.自监督的训练概述。 在我们的自监督方法中,我们(a)对合成数据预先训练一个初始兴趣点检测器,并且(b)应用一种新颖的“单应性适应”步骤来自动标记来自未标记目标区域的图像。 生成的标签用于(c)训练一个全卷积网络,该网络从图像中联合提取兴趣点和描述符。

全息适应技术旨在实现对兴趣点检测器的自我监督训练。它多次扭曲输入图像,以帮助兴趣点检测器从许多不同的视点和比例看场景(请参阅第5节)。我们将同形匹配技术与MagicPoint检测器结合使用,以提高检测器的性能并生成伪地面真相兴趣点(见图2b)。产生的检测结果更具可重复性,并且会刺激更大的一组刺激。因此,我们将结果检测器命名为SuperPoint。

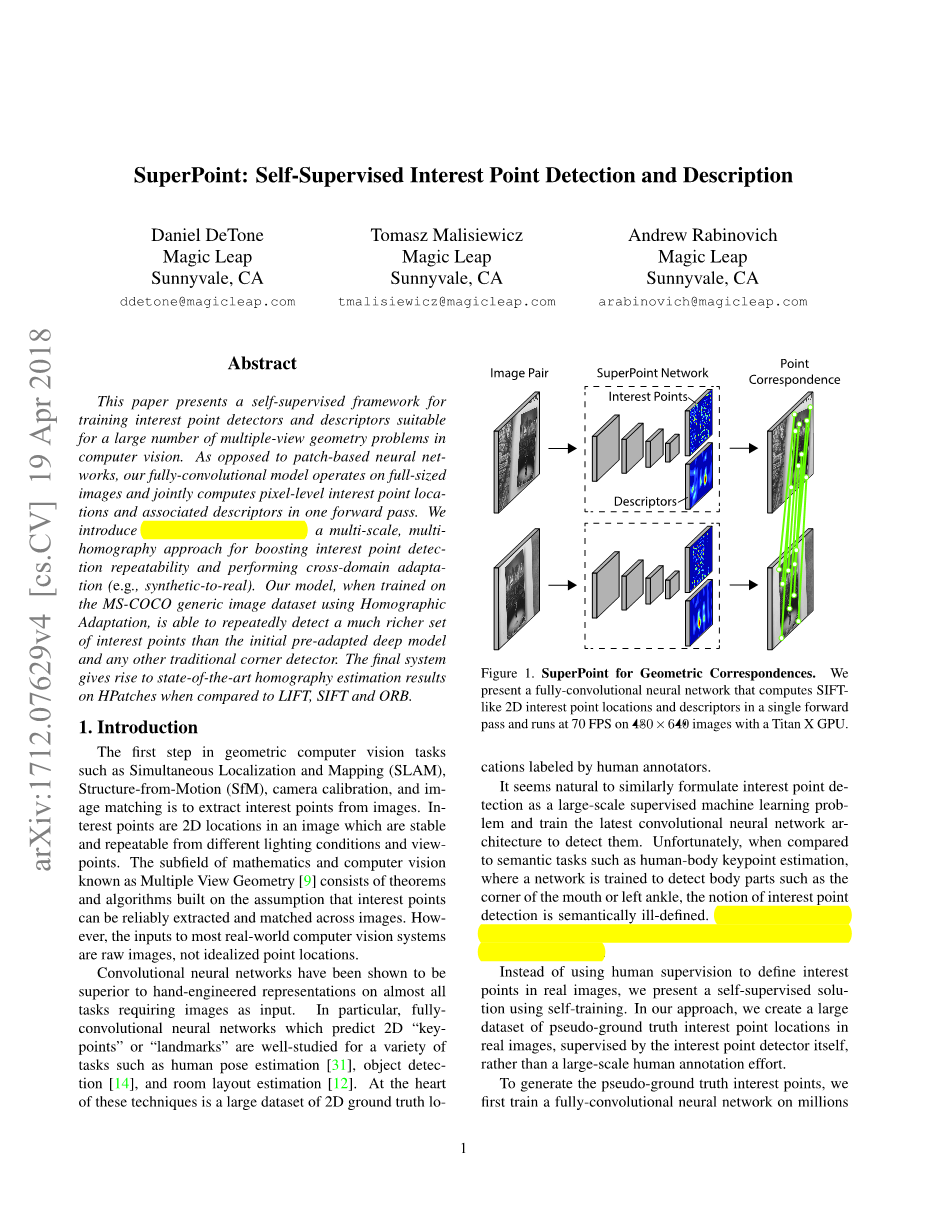

在检测到健壮且可重复的兴趣点之后,最常见的步骤是将固定维度的描述符向量附加到每个点上,以执行更高级别的语义任务,例如图像匹配。因此,我们最后将SuperPoint与描述符子网组合起来(参见图2c)。由于SuperPoint体系结构由提取多尺度特征的深层卷积层组成,因此很容易将兴趣点网络与计算兴趣点描述符的其他子网组合在一起(请参阅第3节)。生成的系统如图1所示。

单应性适应技术旨在实现对兴趣点检测器的自我监督训练。它多次变换输入图像,以帮助兴趣点检测器从许多不同的视角和比例看场景(请参阅第5节)。我们将同形匹配技术与MagicPoint检测器结合使用,以提高检测器的性能并生成伪真值兴趣点(见图2b)。产生的检测结果更具可重复性,并且会刺激更大的一组刺激。因此,我们将结果检测器命名为SuperPoint。

在检测到健壮且可重复的兴趣点之后,最常见的步骤是将固定维度的描述符向量附加到每个点上,以执行更高级别的语义任务,例如图像匹配。因此,我们最后将SuperPoint与描述符子网组合起来(参见图2c)。由于SuperPoint体系结构由提取多尺度特征的深层卷积层组成,因此很容易将兴趣点网络与计算兴趣点描述符的子网组合在一起(请参阅第3节)。生成的系统如图1所示。

图1. SuperPoint之图像匹配。 我们提出了一种全卷积神经网络,该网络可以在一次前向通过中计算类似于SIFT的2D兴趣点位置和描述符,并使用Titan X GPU在480times;640图像上以70 FPS运行

2.相关工作

传统的兴趣点检测器已经过全面评估[24,16]。 FAST拐角检测器[21]是第一个将高速拐角检测作为机器学习问题的系统,并且Scale-Invariant Feature Transform或SIFT [15]仍然可能是最著名的传统局部特征描述符在计算机视觉中。我们的SuperPoint架构受到将深度学习应用于兴趣点检测和描述符学习的最新进展的启发。在匹配图像子结构的能力上,我们类似于UCN [3],并在较小程度上类似于DeepDesc [6]。但是,这两者均不执行任何兴趣点检测。另一方面,LIFT [32]是最近引入的SIFT的卷积替代方法,与传统上先基于补丁检测后进行描述类似。 LIFT网络管道包含兴趣点检测,方向估计和描述符计算,但另外还需要经典SfM系统的监督。表1总结了这些差异。

表1.与相关方法的定性比较。 我们的SuperPoint方法是唯一在单个网络中实时计算兴趣点和描述符的方法。

在监管方法频谱的另一极端,QuadNetworks [23]通过无监督方法解决了兴趣点检测问题。然而,他们的系统是基于补丁的(输入是小的图像补丁)和相对较浅的2层网络。 TILDE [29]兴趣点检测系统使用的原理类似于单应性适应;但是,他们的方法没有从大型全卷积神经网络的功能中受益。

我们的方法也可以与其他自我监督方法(从合成域到实际域的自适应方法)进行比较。 Honari 等人提出了一种类似于单应性适应的方法[10]并称之为“等变界标变换”(equivariant landmark transform.)。同样,几何匹配网络(Geometric Matching Networks)[20]和深度图像单应估计(Deep Image Homography Estimation)[4]使用类似的自我监督策略来创建用于估计全局转换的训练数据。但是,这些方法缺少兴趣点和兴趣点匹配,而这通常是执行更高级别的计算机视觉任务(例如SLAM和SfM)所需的。联合姿态和深度估计模型也存在[33、30、28],但不使用兴趣点。

3.SuperPoint 架构

我们设计了一种称为SuperPoint的全卷积神经网络体系结构,该体系结构可在全尺寸图像上运行,并在单个前向通过中生成兴趣点检测以及固定长度的描述符(请参见图3)。 该模型有一个共享的编码器来处理和减少输入图像的维数。 在编码器之后,该体系结构分为两个解码器“头”,它们学习任务特定的权重——一个用于兴趣点检测,另一个用于兴趣点描述。 这两个任务之间共享大多数网络参数,这与传统系统有所不同,传统系统先检测兴趣点,然后计算描述符,并且缺乏在两个任务之间共享计算和表示的能力。

图3. SuperPoint解码器。 两种解码器均以共享且空间缩小的输入表示形式工作。 为了保持模型的快速和容易训练,两个解码器均使用非学习式上采样将表示恢复为R Htimes;W

3.1共享的编码器(Shared Encoder)

我们的SuperPoint体系结构使用VGG样式[27]编码器来减少图像的尺寸。 编码器由卷积层,池化层(进行空间下采样)和非线性激活层组成。 我们的编码器使用三个最大池化( max-pooling)层,将尺寸的原图像转变为。我们将低维输出中的像素称为“单元”,其中编码器中的三个2times;2不重叠的最大池化操作导致8times;8像素单元。 编码器将输入图像Iisin;R Htimes;W映射到具有较小空间尺寸和较大通道深度的中间张量Bisin;R Hctimes;Wctimes;F(即Hc lt;H,Wc lt;W和Fgt; 1)。

3.2特征点解码器

对于兴趣点检测,输出的每个像素对应于输入中该像素是“特征点”概率。 用于密集预测的标准网络设计涉及一对编码器/解码器,其中空间分辨率通过合并或跨步卷积降低,然后通过上卷积运算(如在SegNet中完成)[1]上采样回到全分辨率。 不幸的是,上采样层往往会增加大量的计算,并且会引入棋盘现象[18],因此我们设计了带有显式解码器(采用的子像素卷积方法)的兴趣点检测头,以减少模型的计算量。

兴趣点检测头计算Xisin;R Hctimes;Wctimes;65并输出张量大小的R Htimes;W。 65个通道对应于局部不重叠的8times;8像素的网格区域以及一个额外的“非兴趣点”层。 在通道维度softmax之后,将“非兴趣点”层移除,并进行R Hctimes;Wctimes;64rArr;R Htimes;W的整形。

3.3描述子解码器

描述符头计算Disin;R Hctimes;Wctimes;D并输出张量大小的R Htimes;Wtimes;D。 为了输出L2归一化固定长度描述符的密集图,我们使用类似于UCN [3]的模型来首先输出描述符的半密集网格(例如,每8个像素一个)。 半密集而不是密集地学习描述符会减少训练记忆,并使运行时易于处理。 然后,解码器对描述符执行双三次插值,然后L2将激活标准化为单位长度。 这种固定的,非学习的描述符解码器如图3所示。

3.4 损失函数

最终损耗是两个中间损耗的总和:一个用于兴趣点检测器Lp,另一个用于描述符Ld。 我们使用成对的合成扭曲图像,它们具有(a)伪真值兴趣点位置和(b)来自与这两个图像相关的随机生成的单应性H的真值对应。 给定一对图像,这使我们可以同时优化两个损耗,如图2c所示。 我们使用lambda;平衡最终损失:

兴趣点检测器损失函数Lp是单元xhwisin;X上的全卷积交叉熵损失。 我们将相应的地面兴趣点标签(如果两个角点位置位于同一网格中,则我们随机选择其中一个位置。) Y和各个条目称为yhw。 损失是:

将描述符损失应用于所有一对描述符单元,第一张图像中的dhwisin;D,第二张图像中的drsquo; hrsquo;wrsquo;isin;Drsquo;。 (h,w)单元与(hrsquo;,wrsquo;)单元之间由单应性引起的对应关系可以写为:

其中phw表示(h,w)像单元中心像素的位置,而表示将像素位置phw与单应性矩阵H相乘并除以最后一个坐标,就像在欧几里德坐标和齐次坐标之间进行转换时通常这样做 。 我们用S表示一对图像的整个对应关系集。

我们还添加了一个加权项lambda;d,以帮助平衡以下事实:负数对应的数量大于正数对应的数量。 我们使用合页损失,正边际为mp,负边际为mn。 描述符损失定义为:

4. 合成数据集上预训练

在本节中,我们描述了一种训练称为MagicPoint的基本检测器的方法(如图2a所示),该检测器与单应性适应一起使用,以自我监督的方式为未标记图像生成pseudo-ground truth兴趣点标签。

图4.合成集预训练。 我们使用合成形状数据集,该数据集由渲染的三角形,四边形,线,立方体,棋盘和星形组成,每个都有地面真角位置。 该数据集用于训练MagicPoint卷积神经网络,与传统检测器相比,它对噪声更具鲁棒性。

4.1 合成图形

今天没有大型的兴趣点标记图像数据库。因此,要激发我们的兴趣点检测器,我们首先创建一个大型合成数据集,称为合成形状,该合成数据集通过对四边形,三角形,直线和椭圆进行合成数据渲染来简化2D几何形状。这些形状的示例如图4所示。在此数据集中,我们可以通过用简单的Y形结,L形结,T形结以及细椭圆的中心和线的端点建模兴趣点来消除标签的歧义。

渲染合成图像后,我们对每个图像应用单应变形,以增加训练示例的数量。数据是即时生成的,网络无法看到两次示例。虽然“合成形状”中表示的兴趣点类型仅代表现实世界中所有潜在兴趣点的子集,但我们发现它在训练兴趣点检测器时在实

剩余内容已隐藏,支付完成后下载完整资料

资料编号:[237948],资料为PDF文档或Word文档,PDF文档可免费转换为Word

以上是毕业论文外文翻译,课题毕业论文、任务书、文献综述、开题报告、程序设计、图纸设计等资料可联系客服协助查找。

您可能感兴趣的文章

- 为非政府组织OG慈善基金会设计的基于社区的救灾管理系统外文翻译资料

- 基于UML建模的医疗系统电子健康服务软件外文翻译资料

- 开发一种具有增强现实功能的智能手机应用程序, 以支持护理学生对心衰的虚拟学习外文翻译资料

- 在开发 Web 应用程序中应用 Vue.JS 框架外文翻译资料

- 基于MES系统的生产车间信息管理研究外文翻译资料

- 基于Vue.js和MySQL的电子商务平台的设计与实现外文翻译资料

- 详细的Spring配置和SpringBoot外文翻译资料

- 基于NS2的DSR和AODV协议的性能比较研究外文翻译资料

- 不同仿真参数下NS2的TCP吞吐量性能外文翻译资料

- 基于Spring Boot和VUE的车辆管理系统实现外文翻译资料